原标题:网络系统中的免疫细胞 新无监督学习模型可发现系统中潜行的黑客

一种新的无监督学习模型,可以发现侵入系统的黑客,并在其作出攻击行为前迅速作出反应,发出警报。

2013 年,一群英国情报人员发现大多数的安全工作都致力于阻止黑客入侵,但几乎没有人反过来思考这个问题:阻止已经入侵的黑客泄露信息。基于这个想法,这些人成立了一家新的名为 Darktrace 的网络安全公司,并与剑桥大学的数学家合作,开发了一种利用机器学习模型捕捉内部漏洞的工具。

研究人员没有用黑客攻击的历史实例训练算法,相反,他们需要一种新方法让系统能够识别异常行为。于是,研究人员转向无监督学习模型,这是一种并不常见的基于机器学习算法的技术,其中一个很大的特点在于,它不需要人类指定具体的搜寻目标。

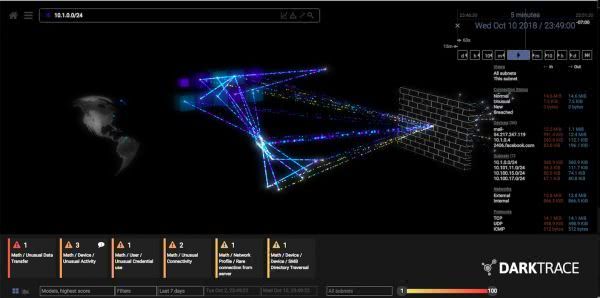

图丨Darktrace 在感染病毒的设备上显示锁定了一个异常行为(来源:DARKTRACE)

Darktrace 联合首席执行官 Nicole Eagan 说:“这个系统很像人体自身的免疫系统,能识别哪些是自己的,哪些是外来的。并在发现外来入侵后,能够做出非常精确而快速的反应。”

绝大多数机器学习应用程序依赖于监督学习。监督学习需要研究人员给机器输入大量经过仔细标记的数据,来训练它识别具体事物的能力。例如,如果你想让机器能识别金毛犬。你需要给它输入成百上千的金毛犬图片和其他非金毛犬图片,同时明确地告诉它哪些是,哪些不是。然后它才能很好的地进行识别。

在网络安全领域,监督学习模型非常有效。用系统以前遇到的各种威胁来对机器进行训练,机器就能掌握隔离这些威胁的能力。

但是监督学习模型有两个主要问题。首先,它只适用于已知的威胁,对未知对威胁束手无策。另一方面,监督学习算法在平衡的数据库下才能很好地运行。换句话说,即对于机器来说,需要特别注意的目标和可忽略的目标在数量上是相当的。然而,网络安全数据是高度不平衡的,比如有少数情况是海量的正常行为中混入了少数的威胁行为。

图丨一个特定子网络中的所有可视化连接(来源:DARKTRACE)

这种情况下,监督学习的效果并不令人满意,而非监督学习就可以派上用场了。非监督学习可以查看大量未标记的数据,并找到不复合典型模式的部分。因此,它可能会识别出系统以前从未见过的威胁,并且只需要很少的异常数据点就能做到这一点。

Darktrace 部署软件时,它在客户的网络周围设置了物理和数字传感器观测网络活动。这些原始数据将导入到超过 60 种不同的无监督学习算法中,让这些算法相互竞争以发现异常行为。

然后,再将这些算法的输出结果传送到另一个主算法中,主算法使用各种统计方法来决定这 60 个算法中哪些行为要注意,哪些行为可以忽略。所有这些复杂的操作都打包成最终的可视化连接,允许操作人员快速查看并对可能的入侵作出反应。而在操作人员得出解决方案之前,系统会隔离这个漏洞,直到它被解决为止。例如,系统会切断所有受感染设备的外部通讯。

当然,无监督学习并不是无懈可击。随着黑客的攻击越来越复杂,无论研究人员使用的是哪种机器学习方式,他们都可能骗过机器。加州大学伯克利分校的网络安全和机器学习专家 Dawn Song 表示:“在这种猫鼠游戏中,攻击者可以改变自己的游戏规则。”

她说,为了应对黑客的改变,网络安全界转向了积极主动的方式,通过建立更好的安全架构和原则,使系统更安全。但要彻底根除所有违规和欺诈行为,还有很长的路要走。“毕竟,整个系统最薄弱的环节就是安全。” Dawn Song 说。