原标题:语音合成论文与韩国小哥 撞车 后续 英伟达 赶紧 开源代码了

乾明 编辑整理

量子位 出品 | 公众号 QbitAI

前两天,量子位报道了

韩国小哥语音合成论文与英伟达撞车

一事。

在得知自己的论文与英伟达的论文“撞车”之后,韩国小哥赶紧在arXiv上提交了论文。并在GitHub上放出了自己研究的源代码。

然后,在Reddit上分享了自己的这一遭遇,引发了大量围观。

英伟达论文的作者之一、负责应用深度学习的副总裁Bryan Catanzaro在回帖中点赞,并且抛出了橄榄枝,希望发帖者能够去英伟达实习。

韩国的小哥有没有联系他,就不得而知了。

但是,英伟达也“赶紧”把自己研究的代码开源了。

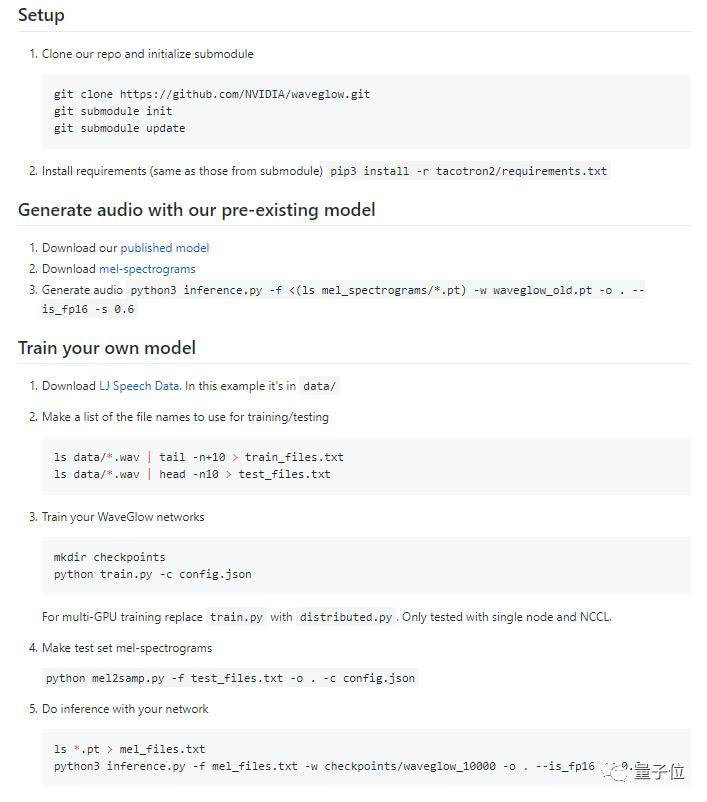

主要内容一共有3个部分、10个小步骤,分别为设置、使用英伟达预置的模型生成音频、训练自己的模型。

英伟达的这个项目,名叫WaveFlow,是一个用于音频合成基于流的生成网络。

关于WaveFlow

英伟达的研究团队介绍称,WaveGlow结合了OpenAI的生成网络Glow和DeepMind的WaveNet,能够提供快速,高效和高质量的音频合成,而无需自动回归(auto-regression)。

而且,WaveGlow只用单一成本函数进行训练,然后使用单一网络实现,整个训练过程非常简单,而且也很稳定。

他们也介绍了使用PyTorch进行论文实现的情况:

在NVIDIA V100 GPU上以超过500 kHz的速率产生音频样本,平均意见得分表明,它合成的音频质量与最佳的公开WaveNet实现一样好。

在英伟达的官方网站上,研究团队发布了合成音频,及其与原始音频、开源WaveNet合成音频的对比(第一遍为原始音频,第二遍为WaveNet合成音频,第三遍为WaveGlow合成音频):

传送门

英伟达GitHub地址:

https://github.com/NVIDIA/waveglow

英伟达论文地址:

https://arxiv.org/abs/1811.00002

韩国小哥GitHub地址:

https://github.com/ksw0306/FloWaveNet

韩国小哥论文地址:

https://arxiv.org/abs/1811.02155